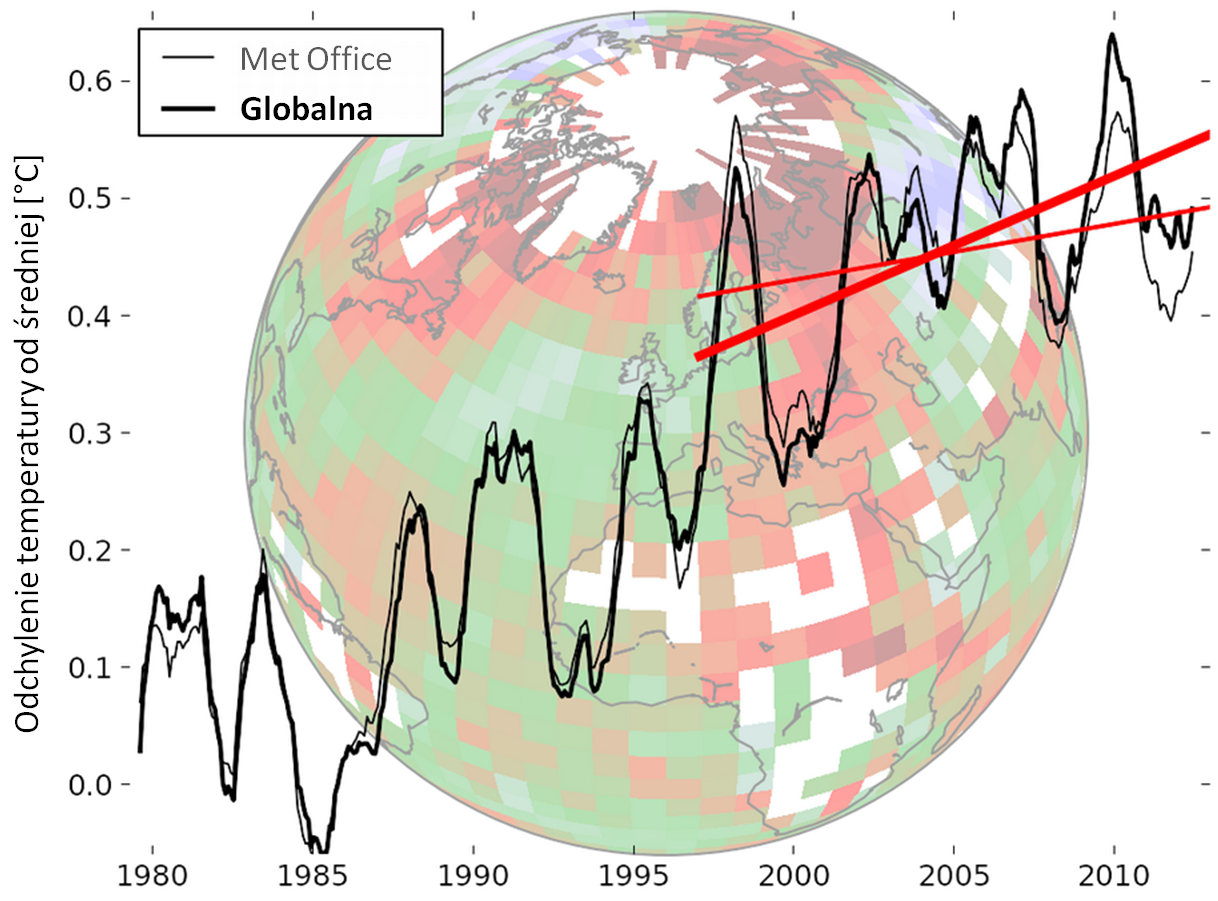

Nowe badania (Cowtan i Way, 2013) pokazują, że wzrost średniej temperatury powierzchni Ziemi w ostatnich 15 latach został poważnie niedoszacowany. Przyczyną są luki w sieci stacji meteorologicznych, szczególnie w Arktyce. Jeśli wypełnić te luki w danych za pomocą informacji z pomiarów satelitarnych, okazuje się, że trend ocieplenia w ostatnich latach jest ponad dwukrotnie większy niż wynika to tylko z danych stacji meteorologicznych, a szeroko dyskutowane „spowolnienie ocieplenia” praktycznie nie występuje. Wyniki badań podsumowuje krótki film

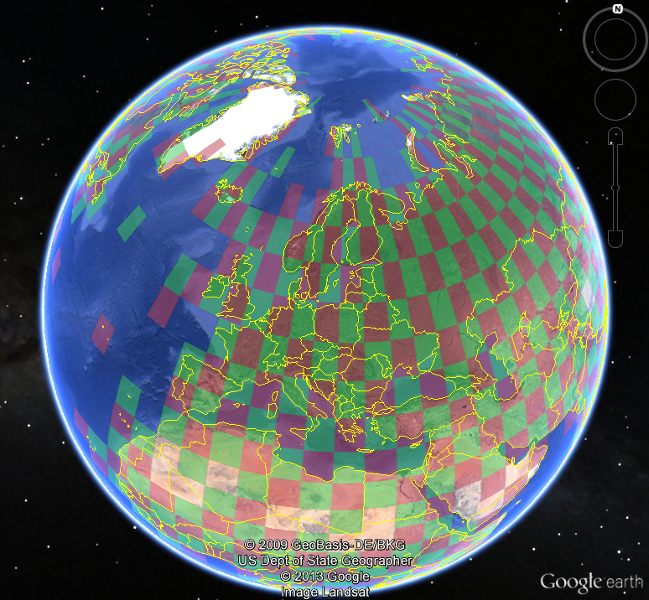

Obliczanie średniej temperatury globalnej na podstawie danych ze stacji meteorologicznych poważnie utrudnia fakt, że nie w niektórych regionach (szczególnie z Arktyki, Antarktydy i niektórych częściach Afryki) stacji po prostu nie ma. Oczywiście, gdyby regiony te ocieplały się w tempie takim jak reszta powierzchni Ziemi, nie powodowałoby to rozbieżności między obserwowanym, a rzeczywistym tempem ocieplania się powierzchni Ziemi.

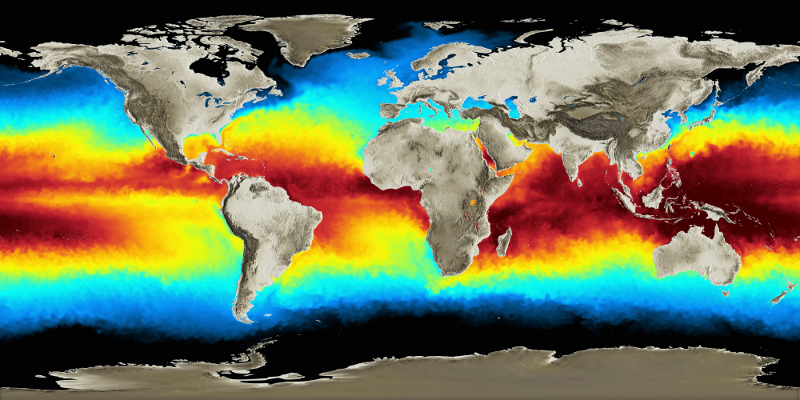

Jednak jeśli tempo ocieplania się obszarów, na których nie ma naziemnych pomiarów temperatury, różni się od średniego tempa wzrostu temperatury na powierzchni Ziemi, pojawi się błąd systematyczny, powodujący błędne oszacowanie tej ostatniej wartości. I to właśnie się zdarzyło. Temperatury w Arktyce rosną znacznie szybciej niż na pozostałym obszarze planety. Pokazują to obserwacje satelitarne i wyniki reanaliz, a potwierdza szybki zanik lodu pływającego.

Regiony, w których temperatura rośnie najszybciej (w szczególności Arktyka), są pomijane w analizach HadCRUT i NOAA, przez co wzrost średniej temperatury globu raportowany przez te ośrodki jest zaniżony. Jest to także przyczyna rozbieżności tych serii pomiarowych względem serii danych NASA GISS – ta jednostka uzupełnia bowiem informacje o temperaturach w regionach pozbawionych stacji, korzystając z danych pomiarowych pochodzących z sąsiednich regionów.

Nowa metodyka określania zmian temperatury globalnej

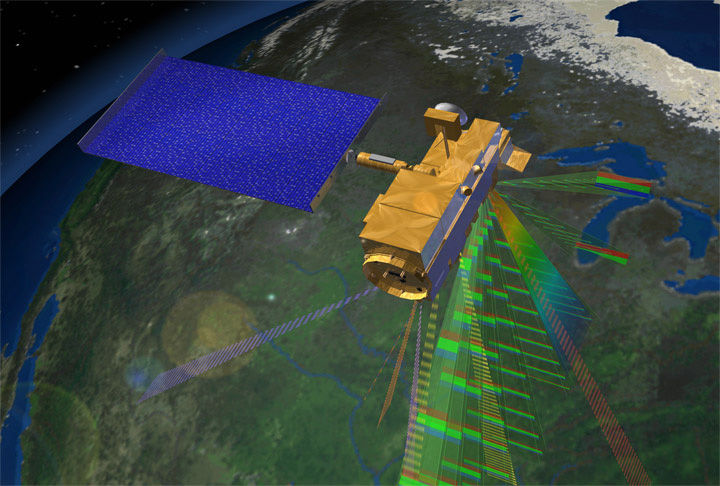

Kevin Cowtan z University of York oraz Robert Way z University of Ottawa opracowali nową metodykę uzupełniania danych dla okolic, w których nie prowadzi się pomiarów naziemnych: skorzystali z danych satelitarnych. Pomysł wydaje się prosty i oczywisty, ale tak nie jest. Po pierwsze, radiometry satelitarne nie pozwalają wyznaczyć temperatury powietrza przy powierzchni gruntu (która mierzy się na stacjach meteorologicznych), lecz na znacznie wyższej wysokości w troposferze*. Po drugie, kwestia długoterminowej stabilności tych pomiarów wciąż nie jest zamknięta (własności przyrządów pomiarowych satelitów oraz ich orbity zmieniają się w czasie, co wymusza stosowanie odpowiednich poprawek przy przetwarzaniu danych).

Cowtan i Way obeszli oba te problemy, stosując tak zwaną metodę interpolacji geostatystycznej (nazywaną też krigingiem – od nazwiska twórcy). Najprościej mówiąc, polega ona na wstawieniu w miejscu, dla którego nie ma danych, średniej ważonej pomiarów z punktów okolicznych. Wagi dobiera się różnie, w zależności od badanego problemu. NASA GISS używa tej metody w analizie temperatur. Cowtan i Wat z kolei skorzystali z niej, by na podstawie różnic pomiędzy danymi z obserwacji satelitarnych i naziemnych w miejscach, gdzie oba rodzaje danych są dostępne, ocenić, ile wynosiłyby one w miejscach, gdzie pomiarów naziemnych brakuje. Obliczone metodą krigingu wielkości posłużyły do „sprowadzania” pomiarów satelitarnych do powierzchni Ziemi w rejonach pozbawionych stacji meteorologicznych. Powstała w ten sposób mieszana („hybrydowa”) seria pomiarowa: w pełni zgodna z pomiarami naziemnymi (tam, gdzie one są) i uzupełniona danymi satelitarnymi (tam gdzie takich pomiarów nie ma) Ponieważ procedura jest przeliczana osobno dla każdego miesiąca, ewentualny dryf pomiarów z satelitów nie wpływa na wyniki.

Skuteczność procedury została zweryfikowana poprzez tworzenie sztucznych dziur w danych z obszarów dla których w rzeczywistości były dostępne wyniki pomiarowe. Porównanie hybrydowych wartości temperatury uzyskanych z pomocą algorytmu interpolacji z wartościami rzeczywistymi pokazało wysoką skuteczność procedury – wyższą niż sposoby interpolacji stosowane obecnie w NASA GISS.

Zaskakujący rezultat

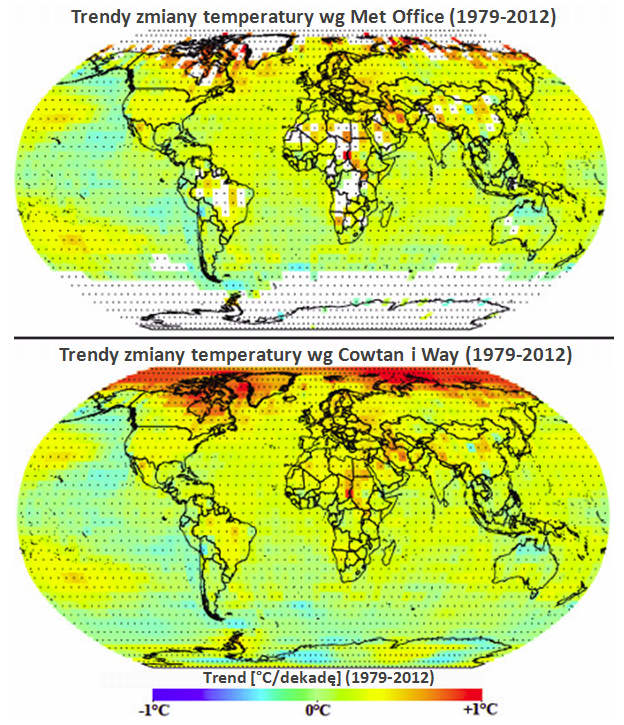

Cowtan i Way zastosowali swoją procedurę do danych serii HadCRUT4, jednej z wiodących globalnych serii pomiarowych, a w której regiony bez stacji meteorologicznych są pomijane. Dla okresu 1998-2012 seria ta pokazuje niewielki trend ocieplenia wynoszący tylko 0,05°C na dekadę – co media często określają jako „przerwę w globalnym ociepleniu”. Jak możemy przeczytać w najnowszym raporcie IPCC:

Z powodu naturalniej zmienności, trendy oparte na krótkich ciągach pomiarowych są bardzo czułe na wybór daty początkowej i końcowej, przez co w ogólności nie odzwierciedlają trendów długookresowych. Przykładowo, tempo ocieplenia w okresie ostatnich 15 lat (1998–2012), który zaczął się od silnego El Niño, wynosi +0,05 [od –0,05 do +0,15] °C na dekadę i jest mniejsze, niż trend obliczony dla lat 1951-2012, wynoszący +0,12 [od 0,08 do 0,14] °C na dekadę).

Tymczasem okazuje się, że uwzględnienie w pomiarach temperatury pomijanych dotychczas obszarów prowadzi do skorygowania obserwowanego trendu wzrostu temperatury z 0,05°C do 0,12°C na dekadę.

Trend 0,12°C na dekadę w pierwszej chwili wydaje się zaskakująco duży, będąc istotnie większy od trendu NASA GISS, wynoszącego 0,08°C na dekadę. Cowtan i Way przyjrzeli się także tej różnicy. Wynika ona z tego, że NASA nie wprowadziła jeszcze nowej metody określania temperatury nad oceanami, która została wprowadzona w zeszłym roku w HadCRUT (przejście od metodyki i danych HadSST2 do HadSST3 – szczegóły opisane są np. tutaj i tutaj). Autorzy wyjaśniają to szerzej w materiałach dodatkowych. Gdyby zastosować metodykę HadSST3 do danych NASA, trend NASA GISS wyniósłby 0,10°C na dekadę, co z dokładnością do niepewności pomiarowych oznacza daleko idącą zgodność.

Podsumowanie

Przeprowadzona w USA analiza mediów pokazała, że mniej więcej w połowie doniesień o ostatnim raporcie IPCC poruszano temat „przerwy w globalnym ociepleniu”. W Polsce odsetek ten najprawdopodobniej był jeszcze wyższy. Często dziennikarze sugerowali, że ta „przerwa” podaje w wątpliwość sam fakt ocieplania się klimatu i ostrzeżeń naukowców.

Rezultaty badania Cowtan i Way (2013) pokazują, że spowolnienie wzrostu średniej temperatury powierzchni Ziemi jest mniej znaczące, niż się wydawało. Owszem, tempo ocieplania się klimatu w ostatniej dekadzie spadło, w dużym stopniu w wyniku transferu ciepła w głębiny oceaniczne (Mit: Globalne ocieplenie się skończyło, Mit: Zmiany klimatu są powodowane zmianami prądów morskich) oraz działającymi chłodząco czynnikami zewnętrznymi (spadek aktywności Słońca, wzrost aktywności wulkanów; patrz Mit: Globalne ocieplenie ma przyczyny naturalne ). Wyniki badań pokazują, że pomimo splotu wielu czynników naturalnych chłodzących powierzchnię Ziemi, średnia temperatura naszego globu i tak szybko rośnie, a obliczone na podstawie ostatniej „pauzy w ociepleniu” niskie wartości czułości klimatu mogą być niedoszacowane.

Marcin Popkiewicz. na podstawie: Real Climate i Skeptical Science

Fajnie, że tu jesteś. Mamy nadzieję, że nasz artykuł pomógł Ci poszerzyć lub ugruntować wiedzę.

Nie wiem, czy wiesz, ale naukaoklimacie.pl to projekt non-profit. Tworzymy go my, czyli ludzie, którzy chcą dzielić się wiedzą i pomagać w zrozumieniu zmian klimatu. Taki projekt to dla nas duża radość i satysfakcja. Ale też regularne koszty. Jeśli chcesz pomóc w utrzymaniu i rozwoju strony, przekaż nam darowiznę w dowolnej wysokości